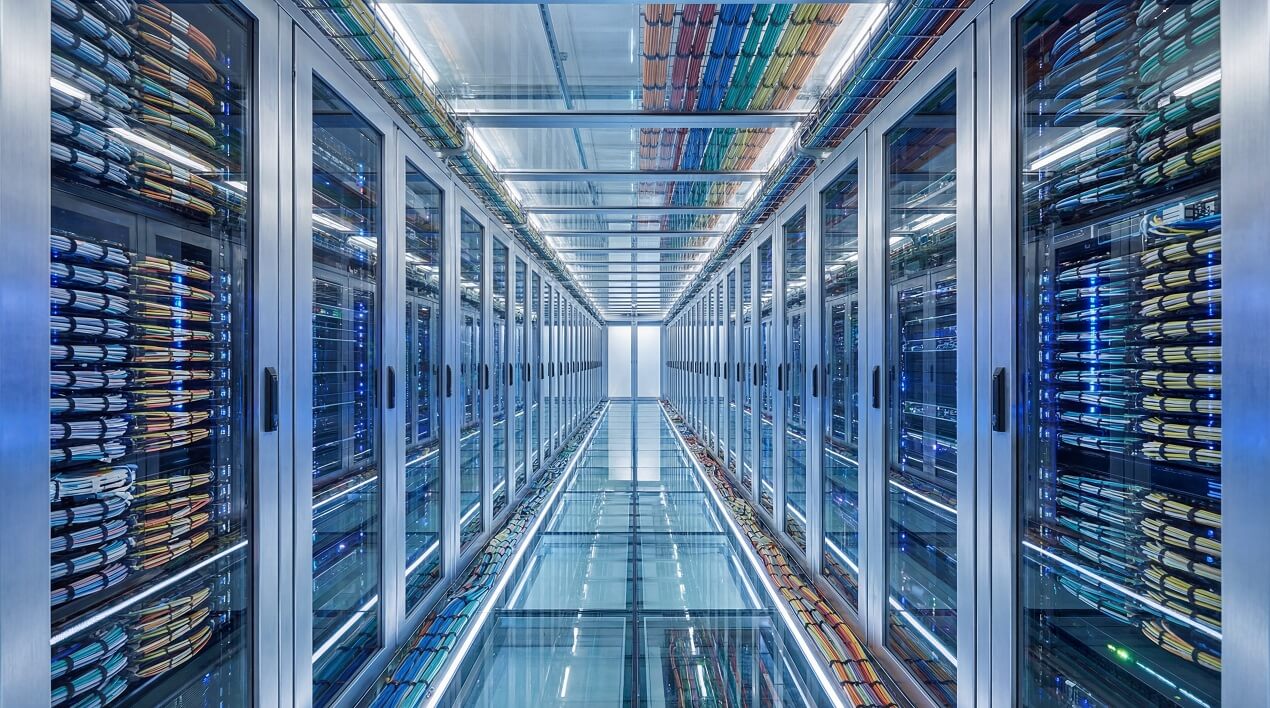

En plena carrera por escalar la inteligencia artificial, AMD ha puesto el foco en un problema cada vez más evidente para la industria: la memoria, y no la capacidad de cómputo, se está convirtiendo en el principal factor limitante de los centros de datos orientados a IA. Así lo expone la compañía en una reciente publicación corporativa en la que analiza cómo la evolución de los modelos de IA está tensionando las arquitecturas tradicionales de servidor.

Según AMD, el crecimiento del tamaño de los modelos y la consolidación de la inferencia continua han cambiado las reglas del juego. En este nuevo escenario, mover datos de forma eficiente consume una parte creciente del presupuesto energético y del rendimiento total del sistema, hasta el punto de condicionar la escalabilidad de las infraestructuras de IA. “Estamos llegando a un punto en el que la memoria se convierte en una restricción de primer orden, tanto en rendimiento como en consumo energético”, señalan desde la compañía.

El análisis de AMD se alinea con una tendencia más amplia del sector: el abandono del modelo de memoria homogénea basada exclusivamente en DDR. En su lugar, los operadores están apostando por arquitecturas de memoria heterogéneas, combinando distintos tipos según las exigencias de cada carga de trabajo de IA.

LPDDR5X: de los dispositivos móviles al centro de datos

Dentro de este nuevo enfoque, AMD apuesta de forma clara por LPDDR5X como palanca para mejorar el rendimiento por vatio en centros de datos. Tradicionalmente asociada a smartphones y portátiles, esta memoria trabaja a menores voltajes que DDR5, lo que permite reducir de forma significativa el consumo energético del subsistema de memoria.

En entornos donde la potencia eléctrica y la refrigeración son factores limitantes, estas mejoras pueden traducirse en ahorros relevantes a escala de rack y, sobre todo, de sala completa, con impacto directo en el coste total de operación (TCO).